Meta e OpenAI vão rotular imagens criadas por IA, mas problemas continuam

Semana passada, falei aqui em minha coluna sobre os fenômenos das deep fakes, o enrosco que é para detectar conteúdos criados por Inteligência Artificial (IA) e a dor de cabeça que os legisladores e reguladores terão nas eleições. Eu prometi que voltaria ao assunto ainda neste ano, só não achei que seria tão cedo.

Nesta terça-feira (6), Meta e OpenAI anunciaram seus planos para identificar as imagens geradas por IA. São iniciativas importantes e que precisam ser valorizadas, mas que estão longe de resolver o problema. O desafio técnico ainda continua gigantesco, e vou explicar isso com mais detalhes.

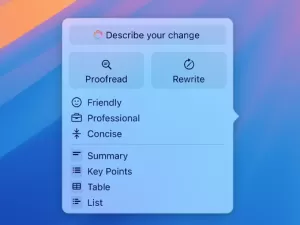

A empresa controladora do Facebook, Instagram e WhatsApp contou que está pronta para identificar imagens feitas com a sua própria IA, a Meta AI, a partir de diversas abordagens. Quando uma imagem realista é criada pelo seu sistema, existem diferentes maneiras de facilitar a identificação, como a adição de rótulos visíveis na imagem, marcas d'água invisíveis (que o usuário não vê, mas que servem para outros modelos de IA identificá-la) e metadados incorporados no arquivo dos conteúdos.

A empresa de Zuckerberg pretende expandir essa funcionalidade para que suas plataformas também identifiquem imagens criadas por ferramentas de outras empresas. Na coluna passada, eu comentei que esse é um problema do ecossistema e que as organizações precisam combinar os padrões para que haja interoperabilidade.

A Meta vem trabalhando com diferentes fóruns, como Partnership on AI, e está adotando os padrões técnicos da C2PA (The Coalition for Content Provenance and Authenticity) e IPTC para rotular imagens que foram produzidas por IAs de outras empresas, como Google, OpenAI, Microsoft e outros.

Coincidência ou não, no mesmo dia do comunicado da Meta, a OpenAI anunciou que as imagens criadas por sua IA incluiriam os metadados com as especificações C2PA, para facilitar que as plataformas de redes sociais possam identificar quais conteúdos foram criados por seus produtos.

Esse é um primeiro passo de uma jornada que vai ser bastante longa. As próprias empresas deixam claro em seus comunicados que, embora esse movimento inicial seja importante, as técnicas que entrarão em vigor no curto prazo são limitadas.

A OpenAI fala, inclusive, que tentar rotular imagens criadas por IA usando metadados não é "bala de prata". Isso acontece porque os metadados baseados nos padrões C2PA podem ser facilmente removidos, seja de maneira acidental ou intencional. Alguém pode retirar os metadados manualmente ou de uma maneira ainda mais corriqueira: com um print da imagem. Ou seja, a solução atual não é efetiva contra pessoas mal-intencionadas e criminosos.

Sabendo dessa limitação, a Meta está trabalhando em uma tecnologia chamada Stable Signature, um mecanismo que irá incluir marcas d'água invisíveis durante o processo de criação de imagens, que dificultam a sua remoção. Mas tudo isso ainda está em fase de desenvolvimento.

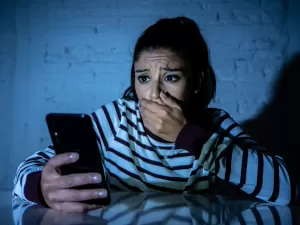

Outra limitação é que essas soluções apresentadas nessa semana funcionam apenas com imagens, mas não com áudios ou vídeos. O desafio técnico é que cada tipo de conteúdo exige estratégias e técnicas diferentes de identificação

Enquanto as empresas ainda tentam construir um mecanismo automático de identificação e controle para a diversidade de conteúdos que será criado por IA, a Meta informou que vai remediar a situação adicionando uma nova funcionalidade para que os próprios usuários sinalizem quando compartilharem vídeos ou áudios gerados por IA.

Essa será uma exigência das plataformas da Meta, e a empresa promete penalidades para quem descumpri-las. Talvez, na prática, essa seja uma medida que não evitará a circulação de imagens sintéticas produzidas por pessoas mal-intencionadas, mas é uma forma de tentar coibir o mau uso e, de certa forma, ajudar no processo de letramento digital.

Embora tenhamos começado a caminhar, não resolveremos os problemas de deep fakes no curto prazo, seja pelas vias técnicas ou de regulação. Reforço a necessidade de um letramento digital para que a sociedade consiga minimamente passear por esse futuro que será inevitavelmente híbrido entre criações humanas e artificiais.

Estou acompanhando o tema de perto e prometo voltar ao assunto assim que tiver novidades. Por enquanto, lembre-se que o "ver para crer" já não é mais real.

Deixe seu comentário