Falta de transparência mancha ação das plataformas digitais no caso Trump

A ideia era a de que esse primeiro texto de 2021 abordasse as perspectivas para o ano. Mas os acontecimentos desta primeira semana reforçaram o que a pandemia já vinha deixando claro desde o ano que passou: o imponderável está sempre à espreita. Basta aparecer a oportunidade. Dessa vez, o levante contra o símbolo maior de democracia no imaginário coletivo: o Congresso Americano.

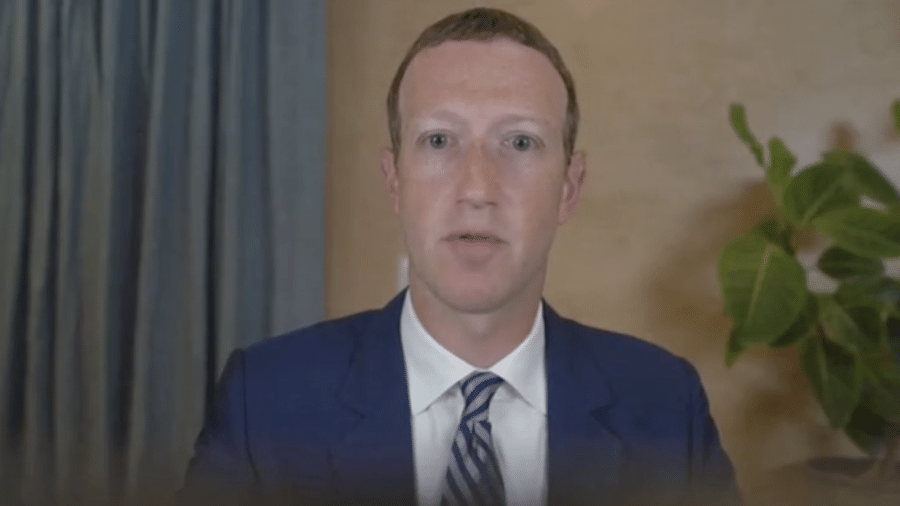

Por tabela, o caos em Washington na última quarta-feira (6), detonou debates acalorados sobre censura e liberdade de expressão na Internet, depois que o Twitter baniu a conta do Trump; Facebook e Instagram congelaram os perfis do presidente temporariamente; Apple e Google suspenderam o aplicativo da plataforma Parler de suas respectivas lojas; e a Amazon suspendeu a Parler de sua unidade Amazon Web Services (AWS), por violação dos termos de serviço.

Por que só agora? Há anos essas plataformas vinham fechando os olhos para as alegações de que Trump (e outros) violavam seus termos de serviço. Quais foram os limites ultrapassados?

Não foi a primeira vez que um chefe de estado usou essas plataformas para incitar violência. Terá sido a última? Difícil dizer. Principalmente porque as empresas digitais não são nada transparentes sobre como regulamentam o conteúdo que veiculam. Impossível afirmar se o fazem de forma consistente e justa, indiscriminadamente.

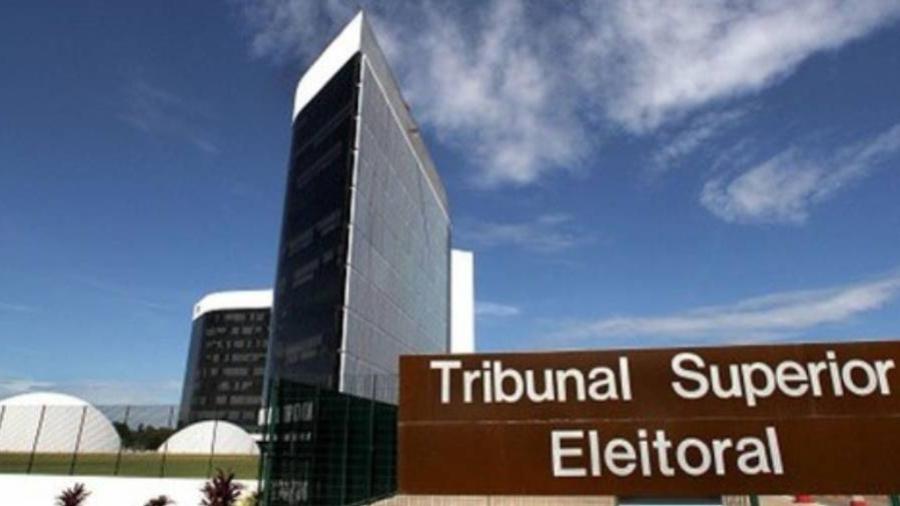

Aumentar a transparência sobre os termos de uso _ sobre o que pode e o que não pode ser feito nessas plataformas _ é o grande desafio diante dos reguladores. Ponto de partida para lidar com o extremismo, a desinformação e a manipulação que consumiram o ecossistema digital, distorceram o discurso público e aprofundaram a polarização nos últimos anos.

Recentemente, a Global Network Initiative (GNI) reuniu especialistas da indústria e da comunidade de direitos humanos para examinar dezenas de iniciativas de regulamentação de conteúdo em mais de uma dúzia de países. A análise revela o quanto uma regulamentação equilibrada pode ajudar a melhorar o ecossistema digital, fornecendo clareza, previsibilidade, transparência e responsabilidade aos esforços das empresas e dos governos para lidar com a moderação de conteúdo, sem ferir o desejo e o direito de liberdade de expressão. E clama por processos de regulação de conteúdo abertos, inclusivos, deliberativos e baseados em evidências.

No caso das redes sociais, se quisermos limitar a difusão de conteúdo impróprio, sem prejudicar a liberdade de expressão, precisamos de abordagens regulatórias claras e abrangentes, prega o relatório. Do contrário, mesmo regras elaboradas com as melhores intenções podem acabar silenciando quem não deveria ser silenciado, e ampliando a voz de quem não deveria ter a voz ampliada.

Uma das recomendações mais importantes desse documento da GNI é a de criação de mecanismos plurais que auxiliem as empresas privadas em seu papel de juízas, júri e executoras da legalidade do conteúdo e conduta dos usuários. As empresas podem - e até devem - aplicar regras que promovam os direitos humanos, independentemente da regulamentação governamental. Mas, para isso, devem garantir que suas regras sejam transparentes.

Também é preciso garantir a existência de mecanismos de resolução de conflitos, uma vez que por mais claras que as regras sejam, e por mais eficientes que sejam os processos e sistemas de moderação, ainda assim reguladores e empresas cometerão erros.

Em outras palavras, as empresas devem permitir que os usuários apelem das decisões de moderação de conteúdo a órgãos independentes. E governos e reguladores também precisam estar sujeitos a mecanismos de transparência e responsabilização.

Não é uma equação fácil. Mas nem por isso devemos nos furtar a um debate franco e aberto sobre como essas plataformas devem ser tipificadas e reguladas. Hoje elas fazem as vezes de praças públicas, mas são jardins murados, com regras próprias, como um clube, muito pouco transparentes. Devem continuar assim? Devem ter limites?

Se há uma lição relacionada à tecnologia na semana passada é que as barreiras entre a vida online e offline desapareceram completamente. Eles são a mesma coisa. Duas partes do que é estar vivo agora. Isso muda a maneira como pensamos sobre a regulamentação de qualquer plataforma digital, e sobre como pensamos questões como privacidade, moderação, interfaces de usuário, responsabilidade corporativa, etc.

Vale lembrar que, além das plataformas já mencionadas anteriormente, o Shopify também removeu duas lojas online administradas pela Trump Organization e a campanha Trump, que vendiam roupas da marca Trump. Declarou não aceitar lojas ou merchandising de quem incita a violência.

Por fim, é simbólico que o mandato de Trump esteja sendo concluído com um referendo sobre sua atividade nas redes sociais. Ele usou as plataformas, para vários fins, como nenhum presidente - ou líder mundial - antes. Fez escola, como bem sabemos. Pesos e contrapesos serão necessários. Que saibamos escolhê-los e instaurá-los.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.