Com uso dos dados, máquinas já conseguem prever o futuro de uma pessoa?

Uma das várias visões do futuro comum entre futurólogos, tecnocratas e escritores de ficção científica é o de uma sociedade bem planejada e automatizada. Nessa sociedade o governo ou um supercomputador seria capaz de ajustar o ambiente de cada um dos indivíduos —alimentação, educação, lazer, carreira— para otimizar a experiência de todos.

Em "Admirável Mundo Novo", Aldous Huxley descreve uma sociedade em que o governo controla o número de humanos gerados em cada classe social e usando condicionamento gestacional e infantil para criar cidadãos produtivos em suas respectivas castas.

O cientista Norbert Wiener discutiu no livro "Cybernetics" a possibilidade —e os perigos— de comunidades com um "controlador" capaz de enxergar os "desvios" sociais e ajustar as intervenções para descontar os desvios, atuando igual um termostato regula a temperatura de uma casa.

Salvador Allende chegou até a tentar implementar uma versão dessa sociedade no Chile. A ideia em voga de que vivemos em uma simulação carrega consigo ecos desse conceito: nós já vivemos em uma sociedade dessa natureza, pois somos todos uma simulação.

Essa visão distópica (utópica em alguns círculos) tem uma premissa oculta: a de que sociedades operam de uma forma determinística, ao menos coletivamente. Para que possamos acreditar que o controle do ambiente de um indivíduo pode ser usado para corrigir o futuro, é preciso primeiro acreditar que o ambiente do indivíduo determina qual era esse futuro.

Essa premissa é intuitiva. Todo mundo entende que alimentação adequada e educação de qualidade melhoram o futuro de qualquer criança. Mas a gente não sabe muito bem a granularidade disso. Estudos sobre racismo estrutural mostram o efeito coletivo do ambiente. Mas e se o desafio fosse olhar para uma criança e tentar prever o futuro dela?

Um grupo de pesquisadores de Princeton lançou esse desafio e mostrou que é extremamente difícil de prever o futuro de crianças mesmo tendo acesso a um número enorme de dados sobre a criança e a família.

Em um artigo publicado na PNAS de janeiro do ano passado, Salganik et. al. descrevem um "concurso" de big data sociológico com 160 participantes. Cada um dos participantes recebeu 12.942 dados socio-econômicos de 4.242 famílias.

Esses dados vieram do "Fragile Families", um banco de dados de famílias com crianças nascidas no ano 2000 formado em seis ondas, quando as crianças tinham um, três, cinco, nove e 15 anos de idade. Apenas uma parcela dos dados da sexta onda, porém, foi distribuído para os participantes, para utilizar como conjunto de treino. O desafio era ver se os participantes seriam capazes de prever dados não-distribuídos da sexta onda usando métodos "big data".

E o resultado foi devastador para os participantes. Nenhum participante foi capaz de prever razoavelmente bem nenhuma das seis métricas lançadas como desafio --miséria familiar, média escolar da criança, empenho da criança, moradia familiar, educação parental e emprego parental.

Além disso, os métodos sofisticados utilizando infinidade de dados por família teve um desempenho muito próximo de um método extremamente simples: regressão linear utilizando apenas quatro dados (raça, educação e estado civil da mãe à época do nascimento e o status da criança na quinta onda).

Esse resultado demonstra que a capacidade de prever o futuro de famílias usando aprendizado de máquina sofisticadíssimo não é muito melhor que uma regressão simples, e que ambos os métodos são ruins.

Um segundo resultado, para mim mais intrigante, foi que os diversos participantes cometiam o mesmo tipo de erro. Apesar de usar métodos diferentes, as previsões foram muito similares, fossem as previsões corretas ou erradas.

Esse tipo de resultado indica que faltou algum dado extremamente importante para descobrir o futuro da criança. Mas o banco de dados continha uma gama enorme de informação, e apenas dados genéticos e geográficos foram omitidos para garantir a privacidade das crianças.

A ausência de dados geográficos é notável, dado que sabemos o impacto do CEP na expectativa de vida ou na educação de uma pessoa. Mas é difícil crer que a ausência de dados geográficos não seria compensada por dados sobre renda familiar, educação parental, alimentação, moradia, acesso a saúde e toda uma infinidade de substitutos. A falha aponta mais para um limite do aprendizado de máquina em si.

A professora de Sociologia Filiz Garip, da Cornell, em um comentário também publicado na revista PNAS (Proceedings of the National Academy of Sciences), indaga se esse resultado questiona a capacidade de prever o desempenho individual.

Esse resultado é notável dado o momento tecnológico em que vivemos, onde o par "big data" e "aprendizado de máquina" estão devorando a sociedade inteira.

O estado de Nova York experimentou utilizar esse sistema para determinar fiança de réus e acabou replicando, no computador, o racismo estrutural do sistema penal.

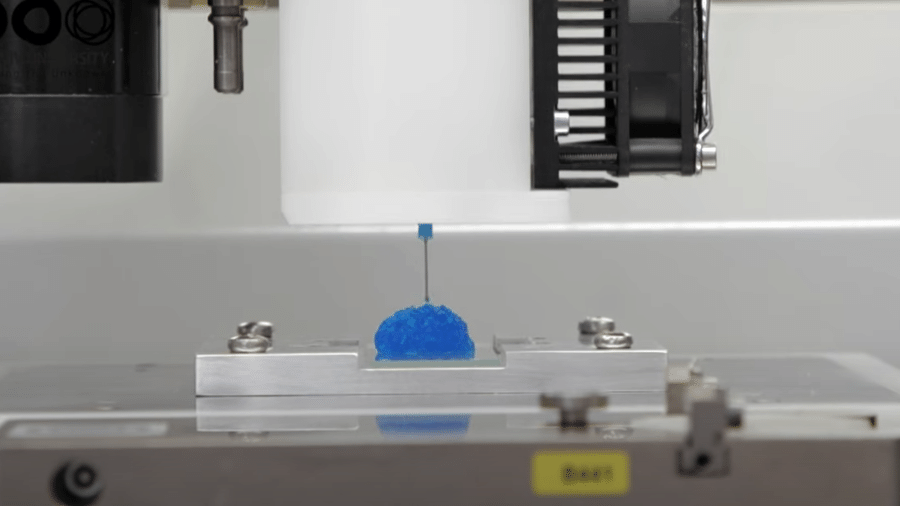

Em um estudo utilizando inteligência artificial para distinguir tumores benignos de melanomas na pele, o algoritmo classificava a imagem usando a presença de uma escala em vez de analisar o formato ou a estrutura do tumor, pois tumores malignos costumam ser acompanhados de uma medição do tamanho.

Nesse ano passado, a interação entre discriminação racial e automatização via aprendizado de máquina foi centro de uma enormidade de controvérsias, mas todas presumem a viabilidade e eficácia do método.

É como se bastasse ter designers conscientes dos problemas sociais, uma enormidade de dados e engenheiros capazes de construir software e hardware para processar todos esses dados. Mas tem uma pergunta mais metafísica por trás disso: seriam as pessoas e as coisas redutíveis a dados?

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.