Texto em que o autor apresenta e defende suas ideias e opiniões, a partir da interpretação de fatos e dados.

Pornô de vingança, golpes e mais: já se deu conta dos riscos do deepfake?

O deepfake vem sendo cada vez mais usado comercialmente. Ele está crescendo de forma rápida em áreas como educação, notícias e entretenimento, apesar das conotações negativas em torno do termo e o fato de as pessoas não quererem se associar a algo que seja "fake".

Você deve está aí se perguntando: tá, mas o que é um deepfake? É uma técnica que permite inserir o rosto de uma pessoa em fotos ou vídeos alterados por meio de inteligência artificial. Na prática, é até bem fácil: basta ter um vídeo da pessoa real como referência e o programa consegue modificá-lo. Já há várias opções de aplicativo para isso.

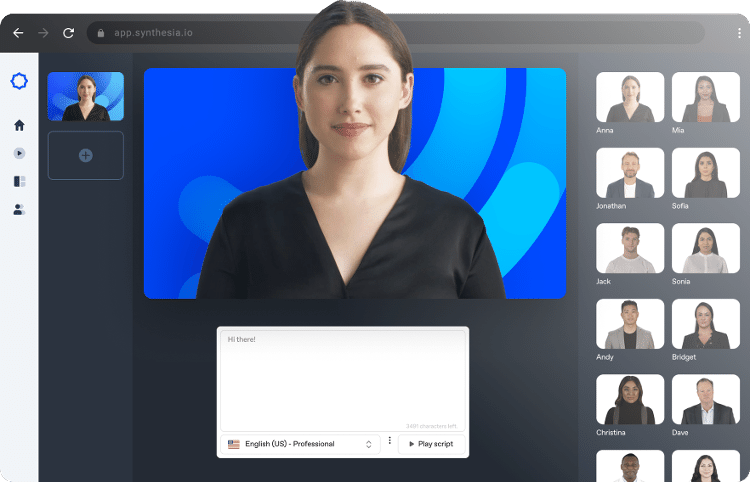

A Synthesia, uma companhia com sede em Londres, foi uma das primeiras da área técnica. Ela criou vídeos de treinamento corporativo com IA (inteligência artificial) para empresas, em parceria com o grupo de publicidade global WPP e a consultoria de negócios Accenture.

Para criar um vídeo utilizando o sistema dessa empresa, é preciso apenas escolher um dos vários avatares, digitar o texto que você quer que seja dito e pronto, a mágica acontece. Não sei você, mas para mim, lembrou quase que um game, não?

Riscos do deepfake

1 - Pornô de vingança

Um tema que infelizmente é bem atual e que já foi pautado por aqui em textos anteriores. O pornô de vingança pode ser um dos usos mais evidentes do deepfake. Dentre tantos casos, um específico me chamou atenção. Especialistas da Sensity (consultoria de segurança especializada em crimes usando IA) descobriram um robô no Telegram que recebia fotos de mulheres e as devolvia aos remetentes mostrando como elas ficariam nuas.

Outros exemplos são ex-parceiros que criam vídeos pornográficos para se vingar e expor vítimas em clipes falsos; ou criminosos que usam a técnica para despir ou mostrar menores de idade em atos sexuais.

2 - Golpes

Imagine você receber um vídeo de um parente, dizendo que está em perigo e que precisa de uma transferência de dinheiro urgente, por exemplo. Mas, na verdade, esse parente está são e salvo, na casa dele - os golpistas apenas o recriaram digitalmente usando um deepfake.

Em agosto de 2019, um caso semelhante ocorreu com uma empresa de energia do Reino Unido. Ela sofreu um prejuízo de R$ 1,3 milhão em um golpe que envolveu um deepfake de um de seus diretores.

3 - Identidades falsas

Outro risco é a criação de identidades virtuais falsas. Seria possível criar pessoas que nunca existiram para empregá-las como bots em redes sociais. Ou então para aplicar golpes e fraudes. Afinal, por que mostrar seu rosto à vítima se você pode usar o de alguém que não existe?

Tem também o problema da biometria por reconhecimento facial. Um deepfake com um rosto igual ao meu ou ao seu poderia destravar nossos celulares, apps, portas...

4 - Disseminar desinformação

Do deepfake para as fake news, é um pulinho. Se as pessoas já acreditam em textos disparados nas redes sociais, ou imagens alteradas por Photoshop, imagine o impacto de um vídeo. Por exemplo, mostrando o político X falando algum absurdo ou o político Y cometendo um crime.

À primeira mão, vai ser difícil determinar se o material é real ou não. A influência na opinião pública pode ter consequências desastrosas.

Um exemplo muito conhecido foi um vídeo do ex-presidente norte-americano Barack Obama, onde ele comentava o filme "Pantera Negra" e criticava Donald Trump. Apesar de parecer um discurso aparentemente normal, era tudo falso. Nada daquilo havia sido dito por Obama. Foi apenas um exercício elaborado pelo cineasta Jordan Peele para mostrar justamente o quanto essa tecnologia pode ser perigosa.

* Colaborou Gabriela Bispo, planner e redatora de conteúdo da InfoPreta.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.